Das Potenzial von KI ist in aller Munde: Mit dem Boom von generativen Tools wie ChatGPT, Midjourney oder DALL:E können in Sekundenschnelle verschiedenste Inhalte erzeugt werden: Texte, Bilder, Videos, sogar Musik!

Auch im Recruiting kann KI einiges leisten und manuelle Aufgaben übernehmen, die Personalverantwortliche aktuell bis zu 10 Stunden Arbeitszeit pro Woche kosten – so die Ergebnisse aus der neuesten Studie von The Stepstone Group State of Recruitment and Automation (2023). Dazu gehören Aufgaben, die relativ leicht automatisierbar sind, wie die Formulierung von Stellenanzeigen oder die Terminierung von Bewerbungsgesprächen, sagen Camille Delorme und Heiner Tent.

Warum braucht es Ethik?

Ethik im Zusammenhang mit künstlicher Intelligenz beschäftigt sich mit Themen wie Transparenz, Datenschutz, Fairness oder auch Anti-Bias-Maßnahmen. Denn werden KI-Lösungen nicht verantwortungsvoll eingesetzt, können weitreichende rechtliche Konsequenzen entstehen. Im Kontext des Recruitings könnten zum Beispiel bestimmte Bewerber*innen aufgrund diskriminierender Kriterien durch einen Algorithmus benachteiligt werden. Datenlecks sind ebenfalls eine Gefahr, wenn sensible Daten nicht ausreichend geschützt und mit einer KI geteilt werden.

„KI hat keinerlei Urteilsvermögen. Deswegen müssen wir die Rahmenbedingungen schaffen, damit KI ethisch funktioniert”, erläutert Carina Stöttner, Mitgründerin des Zukunftsforschungs-Instituts Themis Foresight, im Stepstone Podcast.

KI-Ethik zielt also darauf ab, einen Rahmen zu schaffen bzw. die moralischen Grundsätze und Regeln festzulegen, die eine KI-Technologie verfolgen soll.

KI ethisch einsetzen: Was Unternehmen und Mitarbeitende tun können (und sollten)

Was müssen Mitarbeitende beachten, wenn sie KI-Tools in ihrer Tätigkeit anwenden? Was müssen Unternehmen wiederum gewährleisten, damit die Mitarbeitenden diese Technologie sicher nutzen?

Im Folgenden finden Sie Handlungsempfehlungen für beide Seiten.

Best Practices für Arbeitnehmende

Ergebnisse kontrollieren

Jeglicher Content, der mit generativen KI-Tools produziert wird, sollte von einem Menschen überprüft werden. Zum einen die Kontrolle aus fachlicher Sicht: Stimmen die Informationen und Fakten? Zum anderen müssen die den Text ergänzenden Aspekte wie Links und Quellangaben kontrolliert werden: Müssen Quellen angegeben oder Urheberrechte berücksichtigt werden? Da diese in den Outputs von KI-Tools nicht immer ersichtlich sind, ist dieser Schritt absolut unerlässlich.

KI-erzeugte Inhalte kennzeichnen

Der EU AI Act, ein zukünftiges Gesetz zur Regulierung von künstlicher Intelligenz in Europa, dessen Inkrafttreten für 2026 geplant ist, sieht strengere Transparenzanforderungen vor, um die Erstellung rechtswidriger Inhalte zu verhindern. Es wird erwartet, dass gemäß diesem Gesetz KI-generierte Inhalte schon ab 2025 klar als solche gekennzeichnet werden müssen.

Prompts anonymisieren

Mitarbeitende sollten, soweit möglich, ihre Prompts bzw. die Anweisungen, die sie beispielsweise in ChatGPT formulieren, anonymisieren. Vertrauliche Informationen und Daten, durch die das Unternehmen oder Kunden identifiziert werden können, müssen streng vertraulich bleiben. Dazu gehören Geschäftsgeheimnisse, Preisinformationen, Leistungsberichte, geistiges Eigentum, Codes und personenbezogene Daten.

Chat-Verlauf deaktivieren

In den Einstellungen von KI-Tools wie ChatGPT sollte die Option „Chat-Verlauf & Training“ deaktiviert werden, um die Verwendung von Eingaben für Trainingszwecke zu unterbinden. Es ist auch ratsam, regelmäßig die gespeicherten Eingaben zu überprüfen und zu löschen.

Best Practices für Arbeitgeber

Sensible Daten definieren

Unternehmen müssen definieren, welche Daten mit KI-Tools geteilt werden dürfen und welche im Gegensatz dazu vertraulich sind, und dies klar an die Mitarbeitenden kommunizieren. Auch der Ablauf bei einer versehentlichen Verwendung von sensiblen Daten in einem KI-Tool, sollte den Mitarbeitenden bekannt sein. Dieser Prozess könnte darin bestehen, eine E-Mail an Vorgesetzte oder an ein Sicherheits- oder Legal-Team zu senden.

Platz des Menschen definieren

Die künstliche Intelligenz nimmt eine immer wichtigere Rolle in unseren Arbeitsprozessen ein: Sie kann als kreativer Sparringspartner dienen, Brainstorming unterstützen oder bestimmte Aufgaben automatisiert erledigen. Es ist jedoch entscheidend, eine klare Rollenverteilung zwischen Menschen und Maschine festzulegen, insbesondere im Lichte des kommenden EU AI Act, der darauf abzielt, den Einsatz von KI-Systemen zu regulieren und sicherzustellen, dass diese den europäischen Werten und Grundrechten entsprechen.

Arbeitgeber sollten definieren, welche Aufgaben vollständig von einer KI übernommen werden und bei welchen Aufgaben KI-Tools unterstützend wirken können. Besonders wichtig ist es, Bereiche zu identifizieren, in denen der Mensch die Hauptrolle spielen soll. Gemäß der DSGVO und in Übereinstimmung mit dem EU AI Act ist es unerlässlich, dass wesentliche Entscheidungen, die signifikante Auswirkungen auf das Leben der Mitarbeitenden haben, stets von Menschen getroffen werden. Dies gilt insbesondere im Personalwesen für sensible Phasen wie Vorstellungs-, Jahres- oder Leistungsbeurteilungsgespräche sowie für die Beendigung von Arbeitsverhältnissen. Diese Phasen sind inhärent zwischenmenschlich und erfordern daher persönlichen Kontakt und menschliches Urteilsvermögen.

Andere Prozessschritte, wie die Planung von Vorstellungsgesprächen, können dagegen effizient von einer KI unterstützt werden. Unabhängig von der Phase des Einstellungsverfahrens oder der beruflichen Tätigkeit muss jedoch immer eine natürliche Person für Rückfragen oder bei (technischen) Problemen verfügbar sein, um die menschliche Entscheidungsgewalt und Verantwortung zu gewährleisten.

Veröffentlichung von KI-generierten Inhalten regulieren

Es ist unumgänglich, einen Prozess zu entwickeln, der die Schritte vor Veröffentlichung von KI-generiertem Content definiert. Dies umfasst unter anderem die Prüfung von Fakten, Quellen und das Lektorat von Inhalten.

Transparenz über den Einsatz von KI gewährleisten

Unternehmen sollten über KI-Systeme, die in der Interaktion eingesetzt werden, informieren. Unter dem EU AI Act wird dies verpflichtend. Beispielsweise müssen im Einstellungsverfahren Bewerber:innen wissen, welche Phasen des Prozesses mittels KI unterstützt werden, welche personenbezogenen Daten erhoben, verarbeitet und ggfs. weitergegeben werden.

Trainingsdaten der KI-Lösung überprüfen

Jede KI-Lösung basiert auf Daten, anhand derer das System trainiert wird. Es ist absolut essenziel, diese Datengrundlage zu verstehen. Woher kommen die Daten, mit denen Ihr KI-basiertes Recruiting-System trainiert wird? Sind das beispielsweise öffentliche Online-Profile auf sozialen Netzwerken, historische Einstellungsdaten, Bewertungen, Transkripte von Vorstellungsgesprächen?

Unternehmen müssen in der Lage sein, diese Trainingsdaten einzusehen und bei Bedarf anzupassen. KI-Systeme erfordern sorgfältige und stetige Kontrolle. Nur so können Unternehmen sicherstellen, dass die KI-Lösung rechtskonform eingesetzt wird.

Die „richtigen” Biases festlegen

Im Bereich der Personalbeschaffung gilt es, die sogenannten „unconscious Biases”, also unbewusste Vorurteile, durch die Personen voreingenommen begegnet wird, aus dem Weg zu räumen. Dafür muss unter anderem ausreichend Diversität in den Trainingsdaten einer KI-Lösung sichergestellt sein. Stehen der KI z. B. zu wenige Informationen über Frauen zur Verfügung, könnte es sein, dass sie die Bewerbungen von Frauen „automatisch” aussortiert – eine berüchtigte Erfahrung, die der Online-Riese Amazon 2018 machte.

Sollten also Biases komplett verbannt werden? „So merkwürdig es klingen mag, sind Biases wichtig, weil sie nicht immer negativ sind”, sagt dazu Carina Stöttner. Es geht darum, dass Unternehmen die richtigen Biases für sich definieren, je nach dem, was sie strategisch erreichen möchten. Wenn sie den Fokus auf Gender Equality legen möchten, ist es ratsam, eine gute Parität in den Trainingsdaten zu haben; liegt der Fokus eher auf Diversität oder Internationalität, sollten die Daten möglichst divers sein.

Mitarbeitende fortbilden

Schließen wir mit der goldenen Regel ab: Unternehmen müssen ihre Belegschaft für die Nutzung von KI fit machen.

Studie: The Ultimate Guide to an AI-Powered Workplace

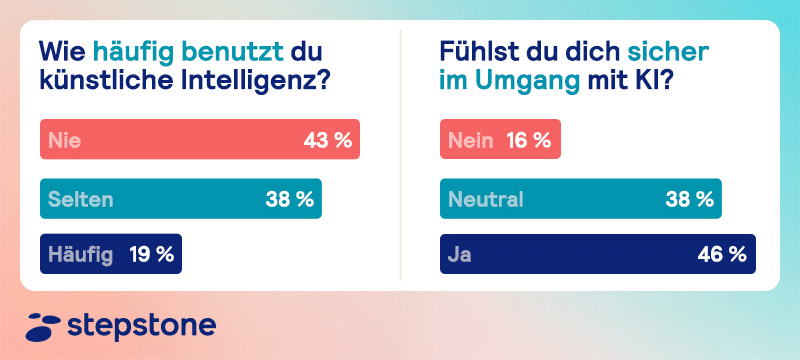

Die 2023 erschienene Studie From Vision to Reality: The Ultimate Guide to an AI-Powered Workplace von The Stepstone Group zeigt, dass insgesamt etwa 6 von 10 Befragten in Deutschland (57 %) bereits Erfahrungen mit KI gemacht haben. 19 % davon setzen KI-Tools in ihrem Job häufig oder täglich ein – meistens mit einem guten Sicherheitsgefühl.

62 % der Befragten sind sich aber über eine Sache einig: Ihr Arbeitgeber investiert zurzeit nicht ausreichend in KI-Trainings. Um ihre Belegschaft KI-fit zu machen und ein Sicherheitsgefühl im Umgang mit dieser Technologie zu fördern, müssen Unternehmen daher in die Entwicklung von Digitalkompetenzen wie kritisches Denken, Datenanalyse und –interpretation investieren.

Mit umfassenden Trainings, z. B. zum Thema Prompt-Engineering stellen Arbeitgeber nicht nur sicher, dass KI-erzeugte Inhalte effizient, sondern auch datenschutzkonform bzw. rechtssicher sind.

Anzeige:

Machen Sie sich KI-fit mit der Stepstone KI-Akademie!

Die Stepstone KI-Akademie liefert Tipps, wie Sie Ihre Belegschaft KI-fit machen, wo KI im Recruiting unterstützen kann und was es dabei unbedingt zu beachten gilt – das Ganze mit leicht verdaulichem Wissen.

Infografiken, Erklärvideos, digitale Vorträge, Experteninterviews, Leitfaden für Ihr Recruiting, Studien und vieles mehr: Sie finden in der KI-Akademie alles rund um den Einsatz von künstlicher Intelligenz in der Arbeitswelt – natürlich kostenlos!

Testen Sie gleich Ihr KI-Wissen in 9 Fragen und entdecken Sie, ob Sie eher ein KI-Frischling oder bereits ein KI-Guru sind!

Newsletter

Newsletter